Ефект Елізи

Ефект Елізи (англ. ELIZA effect) — схильність людей несвідомо антропоморфізувати дії комп'ютера, надавати комп'ютерним символам (словам, знакам) додаткові значення, які формуються лише в людей через особливості сприйняття[1].

Походження терміна

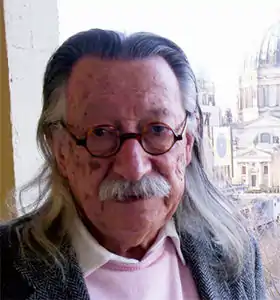

Ефект назвали[2] на честь віртуального співрозмовника, чат-бота ЕЛІЗА. Його створив у 1966 році спеціаліст у галузі теорії обчислювальних машин і систем Джозеф Вейценбаум. Своєю чергою, він назвав свою програму на честь Елізи Дулітл — героїні з п'єси «Пігмаліон» Бернарда Шоу. Комп'ютерна програма ЕЛІЗА імітувала діалог з психотерапевтом, реалізуючи техніку активного слухання. Здебільшого вона перефразовувала відповіді «пацієнта» у запитання — виділяла у вхідній фразі ключові слова й вставляла їх у шаблонну фразу-відповідь.

Наприклад.

Пацієнт. Мій хлопець змусив мене сюди приїхати.

ЕЛІЗА. Твій хлопець змусив тебе приїхати сюди?

Пацієнт. Він сказав, що більшість часу я депресую.

ЕЛІЗА. Мені шкода чути, що ви в депресії.

Пацієнт. Це правда. Я нещаслива.

ЕЛІЗА. Як ви думаєте, те, що ви прийшли сюди, допоможе вам перестати бути нещасливою?

Це перша програму, яку створили для імітації природної людської мови. Однак виявилося, що вона створила ілюзію людського спілкування під час взаємодії людини та машини. Користувачі цієї програми несвідомо приписували ЕЛІЗІ такі людські риси, як емпатію та чуйність. Це трапилося через те, що людина приписує кожному слову якийсь сенс, тоді як машина інтерпретує слова як звичайні дані з символів.

Використання цього віртуального співрозмовника засвідчило існування такого явища, яке згодом назвали ефектом Елізи. Проте ця програма не була досконалою. Після кількох діалогів відповіді ЕЛІЗИ втрачати конструктивний характер, і люди усвідомлювали, що машина не розуміє суті їхніх запитань.

Пояснення ефекту

Ефект Елізи описує будь-яку ситуацію, коли користувачі сприймають комп'ютерні системи як такі, що володіють внутрішніми якостями й вміннями, які програмне забезпечення не може мати. Цей ефект виникає навіть тоді, коли користувачі знають про те, що комп'ютерні програми лише демонструють код, вони не здатні розуміти людські емоції й думки, рефлексувати над ними й співпереживати.

Через ефект Елізи люди можуть не тільки ловити себе на думці, що комп'ютер їх розуміє, а й почати діяти відповідно. Наприклад, у випадку з чат-ботом ЕЛІЗОЮ, секретарка Джозефа Вейценбаума попросила його вийти з кімнати, щоб поспілкуватися з «програмою-психотерапевтом» віч-на-віч.

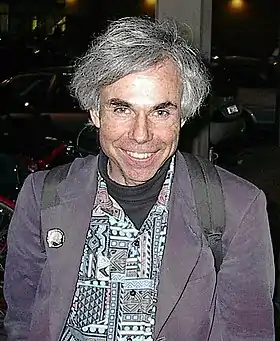

Американський фізик Дуглас Гофстедтер наводить[3] інший приклад ефекту Елізи. Коли банкомат наприкінці транзакції показує слово «Дякую», випадковий спостерігач несвідомо може подумати, що машина висловлює вдячність. Хоча комп'ютер виключно демонструє завчасно запрограмований рядок символів.

З психологічної точки зору, ефект Елізи виникає внаслідок когнітивного дисонансу між усвідомленням людиною обмеженості комп'ютерних систем і результатами, які вони видають.

Негативні наслідки

Програми, які імітують людську мову або поведінку, використовують у багатьох застосунках – у віртуальних асистентах (Siri, Alexa), у терапевтичних застосунках, які надають консультативні послуги (Woebot). Через ефект Елізи користувачі цих програм можуть надавати їм приватну інформацію[4], забуваючи про захист персональних даних. Своєю чергою, розробники цих застосунків, відповідно, IT-компанії та рекламодавці отримують доступ до чутливої інформації. Тому такі розробки необхідно регулювати з боку держави для того, щоб захистити споживачів і забезпечити приватність даних.

Список джерел

- ELIZA effect (англійська). Процитовано 03.11.2020.

- Turkle, S. (1997). Eliza Effect: tendency to accept computer responses as more intelligent than they really are (англійська). London: Phoenix Paperback.

- Hofstadter, D. (1995). Preface 4: The Ineradicable Eliza Effect and Its Dangers (англійська). New York: Basic Books.

- Bassett, Caroline (21.02.2020). The computational therapeutic: exploring Weizenbaum’s ELIZA as a history of the present (англійська). Процитовано 03.11.2020.